The Problem: เมื่อ Chatbot มาถึงทางตันของ UX

ตลอดปี 2024-2025 เราเห็นการเติบโตของ AI Agent อย่างก้าวกระโดด แต่สิ่งหนึ่งที่ยังเป็น "คอขวด" (Bottleneck) คือ User Interface

เราเคยชินกับการสั่ง AI ว่า "จองตั๋วเครื่องบินให้หน่อย" แล้ว AI ก็ตอบกลับมาเป็น Text ยาวเหยียด หรืออย่างเก่งก็ Markdown Table

- User: ต้องพิมพ์ตอบ Text เพื่อเลือกไฟลท์

- Dev: ต้อง Hard-code หน้าจอ Flight Selection เผื่อไว้ หรือใช้

iframeแปะหน้าเว็บอื่นมาแสดง (ซึ่ง UX แย่และไม่ Secure)

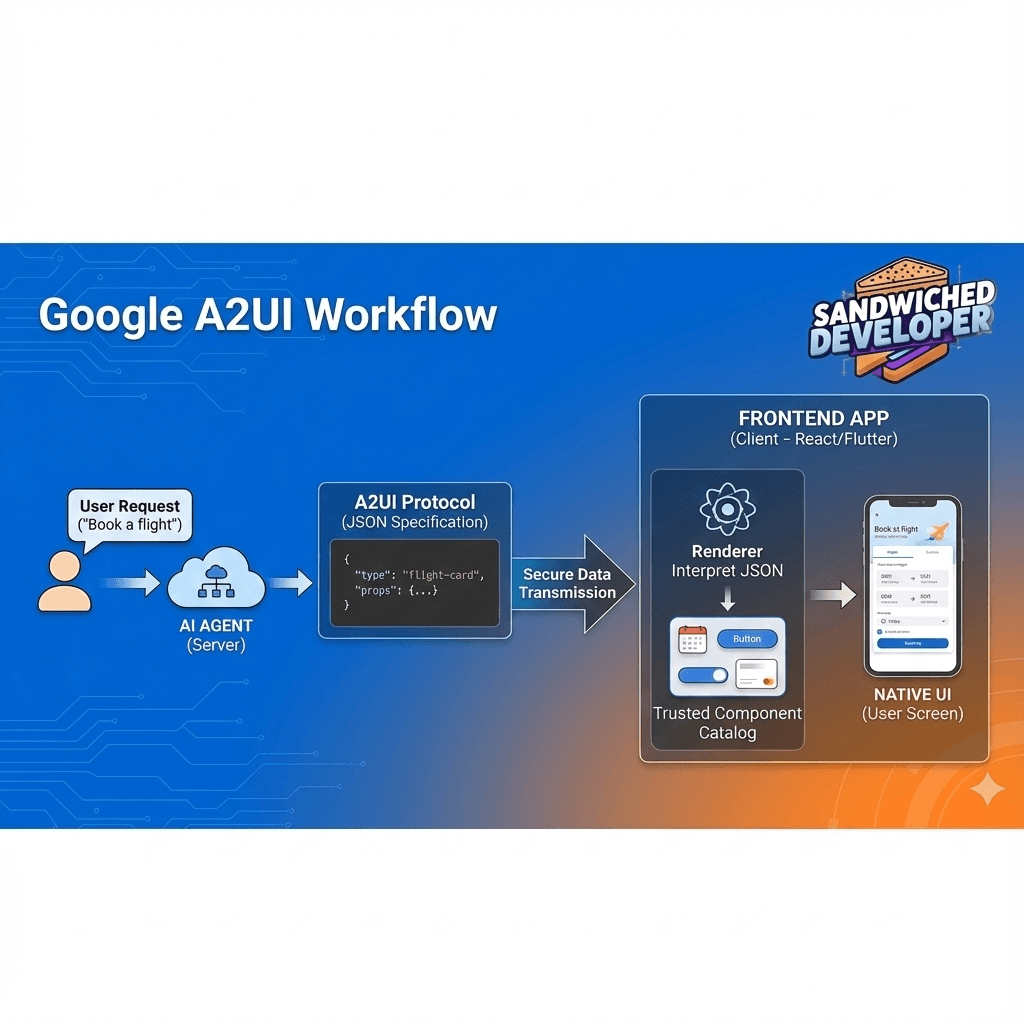

ล่าสุด Google ได้เปิดตัว A2UI (Agent-to-User Interface) โปรเจกต์ Open-source (Apache 2.0) ที่จะมาทลายกำแพงนี้ครับ มันคือ Protocol ที่ทำให้ Agent สามารถ "ส่ง UI" มาหา User ได้โดยตรง แต่ไม่ใช่การส่ง HTML หรือ JS แบบเดิมๆ

ในบทความนี้ ผมจะพาไปเจาะลึกว่าเบื้องหลัง A2UI ทำงานอย่างไร และทำไมมันถึงปลอดภัยกว่าวิธีที่เราเคยใช้กันมา

1. Architecture: A2UI ไม่ใช่ Framework แต่เป็น "Protocol"

สิ่งที่ต้องเข้าใจก่อนคือ A2UI ไม่ใช่คู่แข่งของ React, Vue, หรือ Flutter แต่มันคือ "ภาษากลาง" (Protocol) ที่ให้ AI Agent สื่อสารกับ Frontend Framework ของเรา

The "No-Code" Rule

หัวใจสำคัญของ A2UI คือ "Declarative Data, Not Executable Code" Agent จะไม่ส่งโค้ด Javascript หรือ HTML String มาให้ Browser รัน (เพราะเสี่ยงต่อ XSS และ Code Injection) แต่จะส่ง JSON Specification ที่ระบุว่า "อยากได้ UI หน้าตาแบบไหน"

ตัวอย่าง JSON Payload (Conceptual): A2UI ใช้โครงสร้างแบบ Flat List / Adjacency List เพื่อให้ LLM สามารถ Stream ข้อมูลมาได้ง่ายๆ โดยไม่ต้องรอปิดวงเล็บ Nested JSON ให้ครบ

{

"updates": [

{

"operation": "add",

"component": {

"id": "flight-card-01",

"type": "card",

"props": { "elevation": 2 }

}

},

{

"operation": "add",

"component": {

"id": "txt-dest",

"type": "text",

"parentId": "flight-card-01",

"props": { "content": "BKK -> NRT", "style": "header" }

}

},

{

"operation": "add",

"component": {

"id": "btn-book",

"type": "button",

"parentId": "flight-card-01",

"props": { "label": "Book Now ($450)", "action": "submit_flight_01" }

}

}

]

}สังเกตว่ามันส่งมาเป็น "List of operations" ทำให้ Client สามารถ Render ทันทีที่บรรทัดแรกมาถึง (Streaming UI)

2. Security First: ระบบ "Trusted Catalog"

คำถามที่ Dev อย่างเรากังวลที่สุดคือ: "ให้ AI เสก UI เอง ปลอดภัยจริงดิ?"

Google ออกแบบ A2UI มาด้วยคอนเซปต์ Trusted Component Catalog ฝั่ง Client (App/Web ของเรา) จะต้องเตรียม "Catalog" ของ Component ไว้ล่วงหน้า เช่น:

<MyButton /><FlightCard /><DatePicker />

เมื่อ Agent ส่งคำสั่งมาว่า type: "datepicker" ตัว A2UI Renderer บน Client จะไปหยิบ Component จริงๆ ของเรา (ที่เป็น React/Flutter code) มาแสดงผล

- ✅ Native Look: หน้าตา UI จะเหมือนแอปเราเป๊ะๆ เพราะใช้ Component ของเราเอง

- ✅ Security: Agent ไม่สามารถเสก

<script>alert('hacked')</script>ได้ เพราะมันทำได้แค่สั่งให้ใช้ Component ที่เราเตรียมไว้ให้เท่านั้น

3. Cross-Platform: เขียน Logic ทีเดียว รันได้ทุกที่

ความเจ๋งอีกอย่างคือ A2UI เป็น Framework-Agnostic JSON ชุดเดิมที่ Agent ส่งมา สามารถนำไป Render ได้หลายที่:

- Web (React/Lit/Angular): Render เป็น DOM Elements ปกติ

- Mobile (Flutter/SwiftUI): Render เป็น Native Widgets

- Tips: ตอนนี้ทีม Flutter มี GenUI SDK ที่รองรับ A2UI แล้ว ทำให้เราสามารถสร้างแอปมือถือที่ AI เปลี่ยนหน้าตา UI ได้แบบ Dynamic

4. Developer Experience: สิ่งที่เปลี่ยนไป

สำหรับ Frontend Developer อย่างพวกเรา การมาของ A2UI หมายถึงการเปลี่ยน Mindset จาก "Pixel Pusher" (วาง Layout เองทุกหน้า) ไปเป็น "Component Architect"

งานของเราจะเปลี่ยนไปโฟกัสที่:

- Building Design System: สร้าง Component Catalog ที่แข็งแรง สวยงาม และ Flexible

- Defining Schema: กำหนดว่า Component แต่ละตัวรับ Props อะไรบ้าง เพื่อให้ AI รู้จัก

- State Management: จัดการว่าเมื่อ User กดปุ่มใน UI ที่ AI สร้างมา จะส่ง Data กลับไปหา Agent ยังไง (A2UI มี Protocol จัดการเรื่อง State Sync ให้แล้ว)

บทสรุป: อนาคตเริ่มแล้ววันนี้

A2UI (v0.8 Public Preview) เป็นก้าวสำคัญที่บอกว่า Google เอาจริงเอาจังกับเรื่อง Agentic Interface มาก มันคือจิ๊กซอว์ชิ้นสำคัญที่จะทำให้ AI Assistant กลายเป็น "Super App" ที่แท้จริง ที่สามารถเสกหน้าจอการทำงานให้ User ได้ตามบริบท ไม่ใช่แค่คุยโต้ตอบไปมา

ในฐานะนักพัฒนา นี่คือเวลาที่ดีที่จะเริ่มศึกษา Design Pattern แบบ Server-Driven UI (SDUI) และลองเล่น A2UI เพื่อเตรียมพร้อมสำหรับยุคที่ Interface ไม่ได้ถูกเขียนโดยมนุษย์ 100% อีกต่อไปครับ

👉 Reference / ไปลองเล่นกันได้ที่:

- Official Spec: a2ui.org

- GitHub: google/A2UI (ยังไม่มีลิงก์ตรงในผลค้นหา แต่หาได้ไม่ยากใน repo ของ google)

ชวนคุยท้ายบทความ

เพื่อนๆ คิดว่าการปล่อยให้ AI คุม UI แบบนี้ จะทำให้ UX พังไหม? หรือนี่คือทางออกเดียวที่จะทำให้เรามี Personalized App ได้จริงๆ? คอมเมนต์แลกเปลี่ยนกันได้ครับ

#GoogleA2UI #GenerativeUI #AI #SoftwareArchitecture #Flutter #React #SandwichedDeveloper

บทความนี้อ้างอิงข้อมูลล่าสุด ณ เดือนธันวาคม 2025 จาก Google Developers Blog และ A2UI.org